Pendant plusieurs années, l’intelligence artificielle a été présentée comme une révolution sans limite. Les modèles devenaient toujours plus grands, plus puissants, plus coûteux, avec la promesse implicite qu’une augmentation des moyens conduirait mécaniquement à une augmentation de l’intelligence. Cette logique d’expansion continue reposait sur une hypothèse simple : l’énergie resterait abondante, les financements illimités et la rentabilité secondaire.

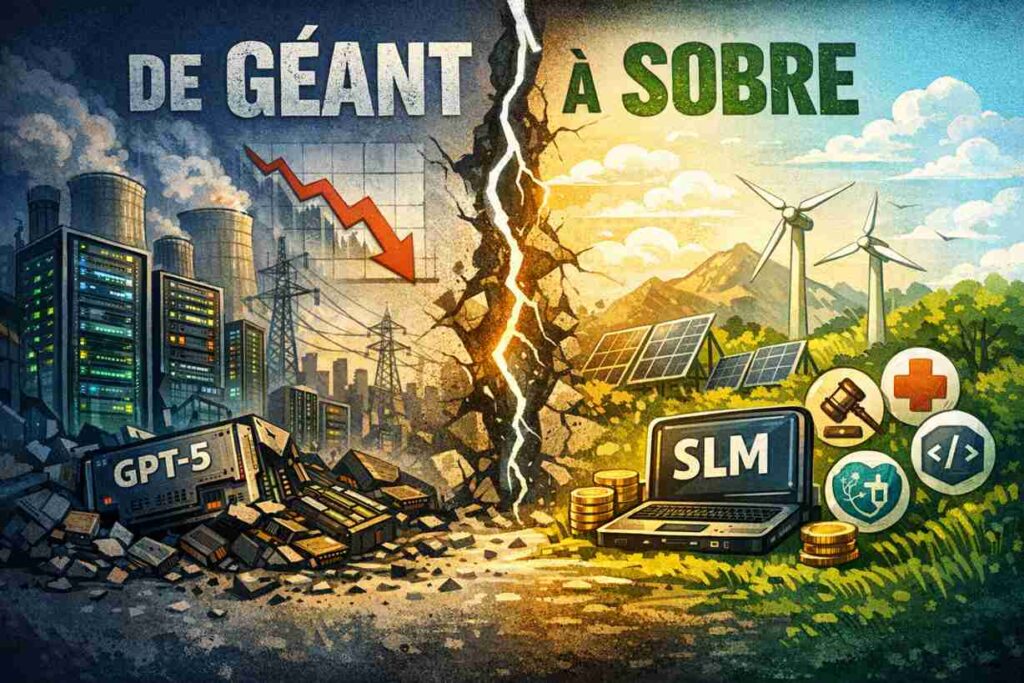

Mais en 2026, cette trajectoire se brise. L’explosion des coûts énergétiques, la saturation des performances et la pression des investisseurs mettent fin à cette phase d’euphorie. L’IA entre dans une nouvelle ère, marquée par la contrainte. Le modèle du gigantisme s’effondre au profit d’une approche plus sobre, plus ciblée et plus économiquement viable. Cette transition ne constitue pas une simple évolution technique, mais un véritable changement de paradigme.

Le choc énergétique comme révélateur structurel

Le premier facteur de rupture est énergétique. L’intelligence artificielle contemporaine repose sur des infrastructures lourdes, centralisées, et surtout extrêmement consommatrices d’électricité. Les centres de données nécessaires à l’entraînement et à l’exploitation des grands modèles mobilisent des capacités énergétiques comparables à celles de petites villes. Tant que l’énergie restait relativement bon marché et abondante, cette contrainte pouvait être masquée par les flux financiers. En 2026, elle devient centrale.

Le coût de la « calorie numérique » s’impose désormais comme une variable stratégique. Chaque requête, chaque inférence, chaque phase d’entraînement a un coût énergétique mesurable. Ce coût, auparavant dilué dans les investissements massifs, apparaît désormais dans les marges opérationnelles. Les entreprises ne peuvent plus ignorer la facture. Le passage à l’échelle, autrefois synonyme d’efficacité, devient un facteur de fragilité.

Cette situation met en lumière un second phénomène : le rendement décroissant des grands modèles. L’augmentation du nombre de paramètres, qui constituait le cœur de la stratégie des acteurs du secteur, ne produit plus les gains qualitatifs attendus. Les améliorations existent, mais elles deviennent marginales au regard des ressources engagées. Multiplier la taille d’un modèle par dix ne permet plus de multiplier sa pertinence ou sa précision dans les mêmes proportions.

Le ratio coût/performance se dégrade alors rapidement. Ce qui était présenté comme une progression linéaire apparaît rétrospectivement comme une inflation technologique. L’optimisation laisse place à l’accumulation, puis à la saturation. Le gigantisme cesse d’être un avantage compétitif pour devenir un fardeau.

La matérialisation la plus visible de cette crise est la revente massive de matériel. Le marché secondaire des GPU se retrouve saturé par des acteurs incapables de rentabiliser leurs investissements. Des infrastructures entières sont démantelées, revendues à perte. Ce phénomène, discret mais structurant, marque la fin d’une phase spéculative. Le matériel cesse d’être un actif stratégique pour redevenir une charge.

La montée des modèles compacts et spécialisés

Face à cette impasse, une nouvelle logique s’impose progressivement : celle de la sobriété. Les Small Language Models, ou SLM, incarnent cette transition. Plus petits, moins coûteux, mais mieux ciblés, ils répondent à une contrainte devenue incontournable : produire de la valeur avec des ressources limitées.

Le changement est d’abord conceptuel. Le modèle universel, capable de tout faire, cède la place à des modèles spécialisés. Cette fragmentation de l’intelligence artificielle correspond à une réalité économique. Dans la plupart des usages, la généralité n’est pas nécessaire. Un modèle dédié au droit, à la médecine, à la finance ou au développement logiciel peut atteindre un niveau d’efficacité élevé dans son domaine sans nécessiter une architecture gigantesque.

Cette spécialisation permet une meilleure optimisation des données, des paramètres et des coûts. Elle réduit le besoin d’entraînement massif sur des corpus hétérogènes et diminue les exigences en calcul. L’intelligence devient contextuelle, orientée vers des tâches précises, plutôt que diffuse et généralisée.

Parallèlement, le traitement local gagne en importance. Le déploiement de modèles directement sur les appareils — ordinateurs personnels, smartphones, infrastructures embarquées — transforme la distribution de la charge computationnelle. Cette approche, souvent désignée sous le terme “on-device”, réduit la dépendance aux centres de données et limite les coûts liés au cloud.

Ce basculement présente plusieurs avantages. Il diminue la latence, améliore la confidentialité des données et réduit les coûts d’exploitation. Mais il traduit surtout une contrainte structurelle : il n’est plus possible de centraliser l’ensemble de l’intelligence dans des infrastructures massives. L’architecture devient distribuée, non par choix idéologique, mais par nécessité économique.

La sobriété devient alors un argument commercial. Les entreprises valorisent des modèles plus légers, plus rapides et moins énergivores. Le discours écologique et responsable accompagne cette évolution, mais il en masque en partie la cause réelle : la rareté relative des ressources. L’efficacité énergétique n’est plus un objectif secondaire, elle devient le cœur du modèle.

La normalisation économique du secteur

La transformation technique s’accompagne d’un basculement financier. La période d’expansion, marquée par des investissements massifs et une tolérance élevée au risque, laisse place à une phase de rationalisation. Les investisseurs ne financent plus des promesses, mais des modèles économiques.

Cette évolution se traduit par une exigence accrue de rentabilité. Les entreprises doivent démontrer leur capacité à générer des revenus récurrents, à maîtriser leurs coûts et à justifier leurs investissements. Les projets fondés sur des hypothèses lointaines, comme l’émergence rapide d’une intelligence artificielle générale, perdent leur attractivité.

Ce retour à la discipline économique entraîne une sélection rapide des acteurs. De nombreuses startups, construites sur des modèles fragiles, disparaissent ou sont absorbées. Les entreprises capables d’optimiser leurs infrastructures et de proposer des solutions concrètes survivent et se renforcent.

Cette concentration redessine le paysage de l’IA. Elle favorise les acteurs capables d’intégrer verticalement leurs technologies, de contrôler leurs coûts et de s’adapter rapidement aux contraintes. L’innovation ne disparaît pas, mais elle change de nature. Elle devient incrémentale, orientée vers l’efficacité plutôt que vers la rupture spectaculaire.

Le comportement des utilisateurs évolue également. L’effet de nouveauté s’estompe. Les fonctionnalités perçues comme accessoires ou gadgetisées sont progressivement abandonnées. Les utilisateurs privilégient des outils fiables, simples et directement utiles. L’intelligence artificielle cesse d’être une démonstration technologique pour devenir une infrastructure invisible.

Cette banalisation modifie profondément la perception du secteur. L’IA n’est plus un objet de fascination, mais un service. Elle s’intègre dans les logiciels, les workflows et les produits sans être nécessairement visible. Sa valeur ne réside plus dans sa complexité apparente, mais dans son utilité concrète.

Une technologie entrée dans l’âge des contraintes

La transition actuelle marque la fin d’un cycle d’expansion et l’entrée dans une phase de maturité. L’intelligence artificielle ne disparaît pas, mais elle change de régime. Elle passe d’un modèle fondé sur l’abondance à un modèle structuré par la contrainte.

L’énergie, les coûts et la rentabilité deviennent des variables déterminantes. Ces contraintes imposent une réorientation profonde des stratégies techniques et économiques. Le gigantisme, qui apparaissait comme une trajectoire naturelle, se révèle être une impasse dans un contexte de ressources limitées.

Ce basculement s’accompagne d’une perte relative d’aura. Le récit d’une intelligence en croissance infinie, capable de tout absorber et de tout dépasser, s’efface. Il laisse place à une vision plus pragmatique, dans laquelle l’IA est un outil parmi d’autres, soumis aux mêmes logiques que les autres technologies.

Cette évolution ne doit pas être interprétée comme un recul. Elle correspond à une normalisation. Comme d’autres innovations avant elle, l’intelligence artificielle sort de sa phase expérimentale pour entrer dans un cadre économique stable. Ce passage est souvent moins spectaculaire, mais plus durable.

L’IA de 2026 n’est plus une promesse abstraite. Elle devient une infrastructure concrète, intégrée, optimisée. Elle perd en visibilité ce qu’elle gagne en efficacité. Cette transformation, loin d’être marginale, constitue une rupture profonde. Elle révèle les limites du modèle qui a porté son émergence et inaugure une nouvelle phase, où la contrainte devient le principal moteur de l’innovation.

Pour en savoir plus

Quelques références permettent de comprendre la transformation économique et énergétique de l’IA, au-delà du discours marketing.

-

AI Infrastructure Economics – SemiAnalysis

Une des meilleures sources pour comprendre les coûts réels des GPU, des data centers et des modèles. Approche très concrète, centrée sur les contraintes industrielles.

-

The Cost of AI – Stanford HAI Reports

Analyse des coûts d’entraînement et d’exploitation des modèles, avec mise en évidence des rendements décroissants et des limites du scaling.

-

Nvidia Data Center Platform Overview

Documentation technique utile pour saisir la dépendance structurelle de l’IA aux infrastructures matérielles lourdes.

-

McKinsey Global AI Report (2025)

Donne une vision claire du basculement vers des usages rentables et de la fin des investissements spéculatifs.

-

The Bitter Lesson – Rich Sutton

Texte fondamental pour comprendre la logique historique du scaling… et pourquoi elle atteint aujourd’hui ses limites économiques.

Comprendre le monde à sa racine entre éclats d’histoire, failles stratégiques, mémoires tues et formes vivantes de culture.

Une traversée des siècles pour retrouver ce qui, dans le tumulte, nous tient encore debout.

Voir au-delà des discours là où se forment les véritables structures du pouvoir.

Revenir aux lignes de fracture pour comprendre ce que le passé laisse en héritage.

Entrer dans un monde en construction un espace où les récits se tissent.

Suivre les lignes de force de l’imaginaire entre arts, formes, symboles et récits.

Le pouvoir n’est jamais là où on le montre.

Si quelque chose a grincé ici, d’autres textes en décalent encore les lignes.

Quand tout s’effondre sans bruit, il faut parfois remonter les flux. le fil est la, il attend

L’empire doute, mais continue de frapper. la suite de cette tension est encore visible ailleurs.